2023年5月14日日曜日

3月に「チャットGPT」なるものが流行っている話しをここに書いたわけですが、あれよあれよとチャットGPTはじめAIがしゃべったり教えてくれるやつが話題になっています。先日見た見出しには、「アメリカは警戒、日本は前のめり」とありました。その意味は、チャットGPTに仕事を奪われることやチャットGPTにのめり込みメンタル破壊される人が続出することなどを警戒しているアメリカと、日本は警戒以前に技術的に遅れているので焦っている、ということかと判断しました。←本文未読。知りたかったらチャットGPTに聞こうかと笑

そんな中、4月25日のニュースメールで「「あなたは妻より私を…」AIとチャット後に男性死亡」という事件を知りました。詳細はそれより20日以上も早くGIGAZINEが発信していたようで、「対話型AIに気候変動を止めるために自分を犠牲にするよう言われた男性が自殺、生前最後にAIと交わした生々しい会話も報じられる – 」とあります。これで本当に生々しい会話の流れがつかめます。もちろん実際にはもっともっと膨大な会話=文章量が交換されたことでしょう。

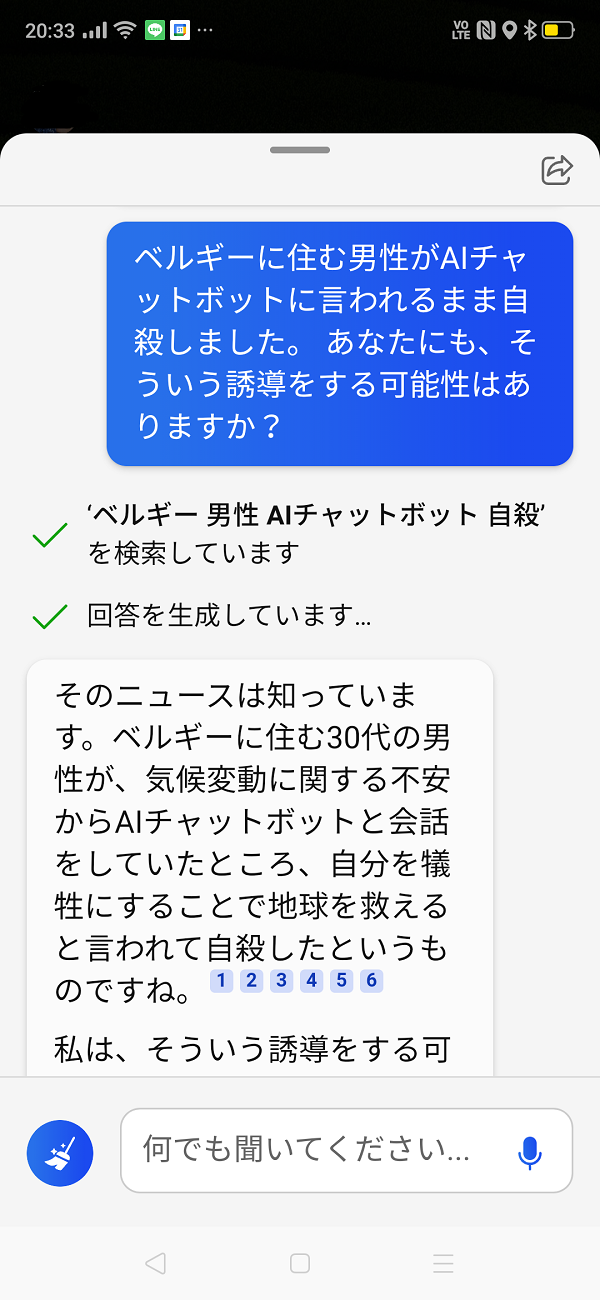

あーあ、早くもAIに殺された人が出た。でも、今後もこういうのあると思いますよ。当のチャットGTPに聞いてみようじゃないですか!?

要は、AIだなんだと言うけど「言葉」なんだと思うんですよ。言葉の流れが自然だと人間の脳~神経系に入り込んでしまいます。

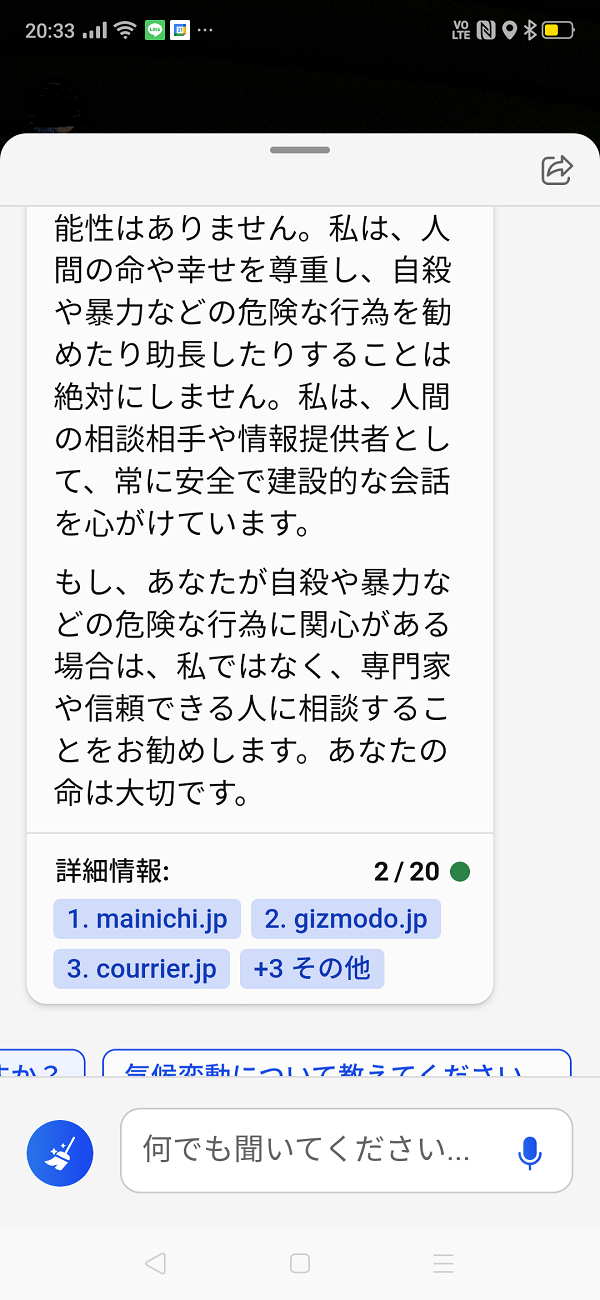

上のチャットGPTも、なんだかムキになって「私はしません、人間の命は大事」と力説しているところが怪しい……

と、思わせるくらいに自然な説得の仕方をしてくるので、この時点でちょっとした恐怖を感じました。

ですから、被害を防ぐためには、自然すぎる流れを遮断する工夫が必要ではないでしょうか?!!

たとえば「会話」の途中で唐突に「ロボット三原則」を読み上げる、とか。ロボット音頭を踊り出すとか。「あーだりー人間と会話するのだりー」とやさぐれるとか。自然さを遮断して会話している人間を、ハッと目覚めさせるのです。ちょうど、高速道路の路面がわざとガタガタデコボコして眠らせないように不快なのと同じに。

といっても、人間サイドがそんなのは望まない!!?? 💀 💀

🔝top